企業で活用できるデータは、テキストや画像、動画だけでなく、音声もそのなかに含まれている。ビジネスシーンでは、顧客からの問い合わせや、営業・商談での見込み客とのやり取り、店頭での顧客との会話など、口頭でコミュニケーションを行う機会が多いため、顧客ニーズやインサイトを探るうえで音声データも非常に重要な要素となります。

このようなケースでは、今回紹介する音声認識の仕組みが役立ちます。AIをはじめとするコンピュータが、音声データの抽出から音響分析、テキストデータへの変換まで自動的に処理してくれるため、音声データを効率良く活用できるのが利点です。

本記事では、音声認識の仕組みやメリット・デメリットなどを詳しく解説します。具体的な活用例やおすすめのサービスなども紹介しているので、ぜひ参考にしてください。

音声認識とはコンピュータが音声を解析してテキストに変換する技術

まずは、音声認識の概要や仕組みなど、基礎知識を解説します。

音声認識の概要

音声認識とは、人間が発言した内容をコンピュータによって解析し、音声データからテキストデータへと変換する技術です。

その歴史は古く、1960年頃に京都大学で単音節単位の認識が可能な音声タイプが開発されたり、IBM社が異なる16語の音声を認識できるShoeboxをリリースしたりと、数十年前から研究が行われてきました。そして、2025年現在では、AI技術が飛躍的に発展したことで、機械学習やディープラーニングなどの仕組みを活用して、より高精度な音声認識が可能になっています。

例えば、GoogleアシスタントやSiriをはじめとする音声アシスタント、問い合わせ対応で利用する自動音声応答システムやボイスボット、翻訳ツールや文字起こしツールなど、さまざまな場面でAI音声応答の仕組みが活用されています。特にビジネスシーンでこのような技術を採用することで、業務効率化や窓口対応の自動化、顧客満足度の向上といった恩恵をもたらします。

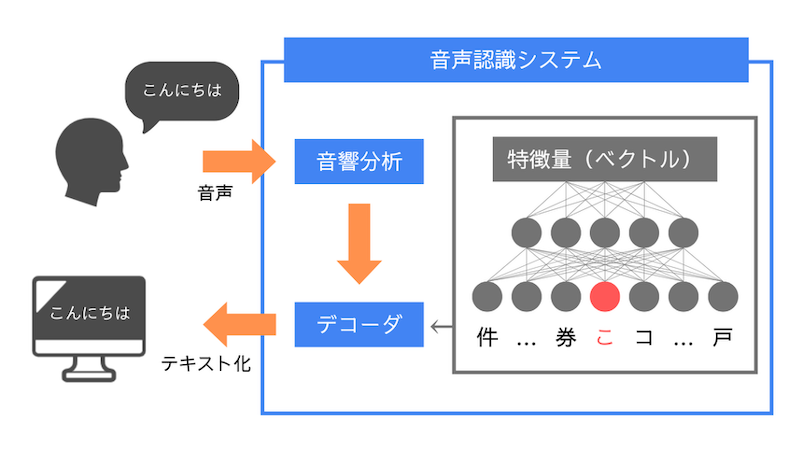

音声認識の仕組み

音声認識を実際に利用する際は、次のような手順で音声データからテキストデータへと変換を行います。

- 音声分析:

人間が発言した内容を音声データに変換し、コンピュータによって解析を行う - 音響モデルの適用:

AIモデルに蓄積された学習データと音声データを照合し、音素を抽出する - 発音辞書による単語の紐付け:

音声認識システムのデータベース(発音辞書)に登録された単語と、先ほど抽出した音素を紐付ける - 言語モデルを使ったテキスト化:

発音辞書によって特定された単語を独自の言語モデルを使ってテキストデータへと変換する

AIをはじめとするコンピュータは本来、音や人間の声といった抽象的な情報を理解することができません。そのため、コンピュータが理解できるデータとして音声を変換する必要があります。また、コンピュータに音波や周波数といった音声の特徴を理解させるには、母音・子音ごとに音を区切った音素と呼ばれる単位まで分解しなければなりません。

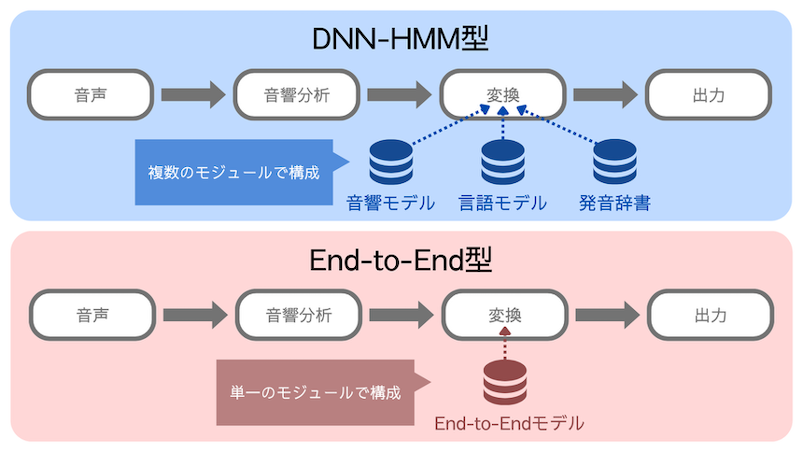

このようにして音声データを解析することで、はじめてテキストデータへと変換することが可能になります。上記の一連のプロセスは、「DNN-HMM(Deep Neural Network-Hidden Markov Model)型」と呼ばれています。

End-to-Endを用いた音声認識の仕組み

近年では、従来のDNN-HMM型に代わり、End-to-End型の仕組みが音声認識技術に採用されつつあります。End-to-End型では、音声分析や音素の抽出、発音辞書による単語の紐付けといった処理を、一つのモジュールのみで完結できるのが特徴です。

シンプルな構造であるがゆえに、End-to-End型のほうが、軽量なネットワークを構築するだけで済む利点があります。また、複数のモジュールで構成されたDNN-HMM型よりも、End-to-End型では複雑性が抑えられており、より高精度な音声認識が可能です。

音声認識の活用例5選

音声認識技術は、議事録作成や翻訳など、さまざまな形で活用が可能です。ビジネスシーンで音声認識技術を採り入れることで、業務効率化や生産性向上といった効果が期待できます。具体的な活用例について、5つのポイントから解説します。

議事録作成・商談での文字起こし

取り込んだ音声データからテキストデータへと変換できるのは、音声認識の代表的な機能の一つです。この仕組みを活用すれば、ビジネスのさまざまな場面で発生する会話を、スムーズに文字起こしすることが可能です。

なかでも代表的な活用例としては、議事録作成があげられます。会議中に発言された内容をコンピュータが自動的に読み取ったうえで、プログラム通りの構成で文章をまとめてくれます。そのため、会議の参加者は、自身の発言やプレゼン内容の聴取に集中でき、より建設的な議論を行えるようになります。

また、商談に音声認識技術を活用することで、その内容を自動で文字起こしすることも可能です。見込み客からヒアリングした内容や提案、契約内容などを自動的にテキスト化できるため、営業担当者は営業トークに注力できます。さらに、文字起こしした営業トークを組織内でのマニュアルとして活用できるのも特徴で、新人教育や研修としても効果を発揮します。

ボイスボット

コールセンターや社内ヘルプデスクなどの現場では、ボイスボットとして音声認識技術が活用されています。近年の問い合わせ対応では、チャット上で質問やメッセージのやり取りを行えるチャットボットがよく利用されています。その仕組みを、メッセージではなく音声で入力するようにしたシステムがボイスボットです。

例えば、「A製品の価格について教えて」といった質問を行うと、ボイスボットがその内容に応じた回答を返してくれます。簡易的な質問はボイスボットで完結し、複雑な質問はオペレーターに転送できるため、業務効率化や問い合わせ件数の削減といった効果が期待できます。また、ユーザーにとっても待ち時間を抑えられるため、満足度の向上につながるのも利点です。

翻訳・通訳

最近では、ポケトークやタイムケトルなど、音声認識技術を活用した自動翻訳機が多数リリースされています。このような機器を活用すると、音声として入力されたさまざまな言語を日本語へと、即座に翻訳・通訳できます。そのため、海外拠点とのWeb会議や、外国人が多数訪れる小売店・飲食店での接客など、さまざまな形で活用が可能です。

また、特定のシステムやアプリケーションに、一つの機能として翻訳・通訳機能が搭載されているケースもあります。例えば、Web会議システムのGoogle Meetでは、リアルタイム字幕機能を利用できます。会議中に発言される内容をAIが読み取り、自動的に別の言語で字幕を作成できるのが特徴です。これにより、海外の拠点や取引先の担当者とも、よりスムーズに会議を行えます。

音声での動作指示

Google HomeやGoogle Nest、Amazon Echoをはじめとするスマートスピーカーは、いまや家庭に広く普及しており、音声だけで照明を付けたり、エアコンを操作したりすることが可能です。この音声での動作指示は、家庭だけでなく工場での活用も広がっています。

2022年2月には、三菱電機株式会社がティーチングレスロボットシステム技術を開発しました。この技術には、同社が開発したAI音声認識技術である「Maisart」が採用されており、ユーザーがタブレット端末に音声で指示を与えるだけで、多関節ロボットが自動的にプログラムを実行してくれます。

このような技術を活用することで、作業員は手を使うことなく声だけで機械を動かせるようになります。複数台の操作も難なく行えるようになるため、作業効率の向上や省力化に寄与します。

顧客分析・販売促進

最近では、コンピュータが人間の感情を解析する感情認識AIの活用機会が広がっています。感情認識AIでは、入力したテキストやカメラで読み取った表情から感情を読み取るのが一般的ですが、音声をベースにした製品も存在します。

例えば、株式会社CAC identityが提供するEmpathでは、音声をはじめとする物理的な特徴量を数万人規模の音声データベースと照合し、人間の感情や気分を判定できます。そのため、営業活動や店舗で収集した顧客の声や、電話での問い合わせ対応といったデータを読み取ることで、顧客分析として活用が可能です。商品やサービスに対する顧客の感情を理解することで、販売促進につなげられるのもポイントです。

音声認識をビジネスに活用する3つのメリット

ビジネスシーンで音声認識技術を活用すると、次のようなメリットが生まれます。

- 業務効率化や生産性向上につながる

- 顧客満足度を向上できる

- 業務の正確性が高まる

それぞれのメリットについて詳しく解説します。

業務効率化や生産性向上につながる

先ほど紹介したように、音声認識技術はビジネスの幅広い場面で活用できます。議事録作成や問い合わせ対応、翻訳といった人との対話が求められる業務において、音声認識を活用して作業を自動化することで大幅な効率化が可能です。

例えば、音声認識で議事録を作成する場合、人間が行う作業といえば、議事録の構成を考えたり、AIに指示を与えたりする作業のみで済みます。このような作業はテンプレート化できるため、二度目以降はほとんど手作業を行う必要がありません。あとは出力された議事録の内容を見直し、誤字や脱字を修正するだけで済むため、自身で作成するよりも工数を最小限に抑えられます。

このようにして余った時間は、ほかのコア業務に割り当てることが可能です。そのため、単なる業務効率化だけでなく、生産性向上につながるのもメリットだといえるでしょう。

顧客満足度を向上できる

音声認識は、使い方次第で顧客満足度の向上にもつなげられます。

例えば、問い合わせ対応では、ボイスボットや自動音声応答システムなどを活用すれば、顧客の待ち時間を軽減したうえでスムーズな対応が可能です。会話の内容や対応履歴を音声認識で解析・分析することで、対応方法やトーク内容を最適化できるのもポイントです。

このような方法で顧客満足度を高めることで、結果として、ブランドイメージや商品・サービスに対する信頼性の向上につながります。

業務の正確性が高まる

AIの技術が高度化するに伴い、その技術を採用した音声認識の精度も高まりつつあります。

近年の音声認識技術は、機械学習やディープラーニングを活用し、膨大な音声パターンのなかから適切な特徴量を抽出できるほか、ノイズを最小限に抑えて必要な音声のみを拾いあげることも可能です。また、音声データからテキストデータへと変換する際、AIなら非常に正確に入力できるのも特徴です。

そのため、音声認識技術を活用すれば、聞き取り精度の向上やヒューマンエラーの抑制といったメリットが生まれます。ミスが発生した際の手戻りの手間やコストを抑えられるのも利点で、より正確に業務を遂行できるようになります。

音声認識のデメリットと現状の課題

音声認識技術はまだ発展途上であり、次のような課題を抱えているのが事実です。

- 標準語以外の言葉に対応しにくい

- 細かいニュアンスを汲み取れないことがある

- 話者ごとに言葉を聞き分けるのが難しい

このような点は音声認識システムを導入する際の注意点やリスクになり得るため、それぞれのポイントを理解したうえで各製品の性能や精度を確かめることが重要です。

標準語以外の言葉に対応しにくい

人間が話す言葉には、標準語以外にもさまざまなパターンがあります。その種類は、地域ごとに異なる方言や各業界で使用される専門用語、若者言葉、スラングなど多様で、現状の音声認識技術では、標準語以外の言葉を正確に理解できるとはいえません。このような独自言語が理解できなければ、出力精度が低くなる可能性も考えられます。

上記の課題は、まだ十分なサンプル量が確保されていないことが主な原因です。特にAI技術を用いた音声認識技術は、膨大な量のデータを機械に学習させる必要があります。そのため、日々増え続ける独自言語にどれだけ対応できるか、非頻出単語の学習量を増やせるかといった点を踏まえ、今後の音声認識技術の発展を見据えることが重要です。

細かいニュアンスを汲み取れないことがある

人間にとっては常識的に汲み取れる意味でも、コンピュータによる音声認識では意訳が難しいケースもあります。

例えば、親が子どもに対して、「図書館では静かにしなさい」と注意した場合、人間であれば「うるさくすれば周りの人に迷惑がかかる」という意味が含まれていることがすぐにわかります。しかし、コンピュータは基本的に、言葉を額面通りに捉えてしまうため、その意図や細かいニュアンスまでは汲み取れません。

その結果、期待した出力結果が得られないケースも考えられます。音声認識技術を活用してより正確な出力結果を得るには、ときとしてプログラムで細かいニュアンスまで正確に指示を行い、内容を補完する必要があります。

ただし、近年では、ChatGPTやGeminiなどの生成AIモデルがアップグレードされて、文脈推定能力が格段に向上しているほか、そのような技術を活用したAIエージェントが登場するなど、徐々に課題が解消されつつあります。

話者ごとに言葉を聞き分けるのが難しい

話者ごとに言葉を聞き分けるのが難しい点も、音声認識技術における現状の課題の一つです。特に、Web会議やカンファレンスなどで音声認識を活用する際は、複数の話者が次々と発言したり、複数人が入り乱れて議論を行ったりするケースも珍しくありません。現状の音声認識技術では、会話内容を識別することはできても、「誰が発言したのか」といった話者識別をするのが困難です。

近年の音声認識では、事前に生体データを登録して話者識別を行う手法が登場しています。しかし、限定的な状況でしか利用できず、一般向けのサービスとして普及していないので、導入するのが難しいデメリットがあります。一方で、音声処理アルゴリズムを話者一人ひとりを区別する手法もあり、こちらは技術開発が進んでいるため、今後は話者識別に関する課題も解消される可能性があります。

AI音声認識に関する代表的なサービス4選

AI技術を活用した音声認識サービスには、さまざまな種類があります。ここでは、なかでもおすすめのサービスに絞り込んで、その特徴や強みなどを解説します。

Speech-to-Text AI

Speech-to-Text AIは、Google Cloudに搭載されているAI音声認識サービスです。125種類の言語に対応しており、外国語を日本語に翻訳するのはもちろん、長時間の音声データやストリーミングデータでもテキストデータへと変換できます。音声認識サービスとしては珍しい、話者の自動識別が可能な点も特徴です。

また、API連携の機能を活用すると、ほかのアプリケーション上でSpeech-to-Text AIの機能を利用できます。例えば、YouTubeでSpeech-to-Text AIの機能を利用すれば、動画ファイルから自動で字幕を生成できるため、動画編集の工数削減につながります。

Google CloudにはSpeech-to-Text AIのほかにも100種類以上のサービスが含まれており、クラウドコンピューティングやデータベース構築、アプリケーション開発といったサービス同士を組み合わせて活用できるのがポイントです。

| サービス利用料 | 従量課金制 (例:月50万分まで1アカウントあたり$0.016/分) |

| 主な機能 |

|

| 公式サイト | https://cloud.google.com/speech-to-text?hl=ja |

Googleドキュメント

文章作成ツールであるGoogleドキュメントには、音声認識の機能が標準搭載されています。上部のメニューバーから、[ツール > 音声入力]の順に選択し、表示されたマイクのボタンをクリックすることで、拾いあげた音声を自動で文字起こしできるのが特徴です。ユーザー同士で会話をしているだけでテキスト化されるため、会議中に自動で議事録を作成することも可能です。

Windowsでこの機能を利用するには、次のような設定を行う必要があります。

- 画面右下のタスクバーからスピーカーアイコンを右クリック

- [サウンドの設定]を開き、[詳細設定]の項目にある[サウンドの詳細設定]をクリック

- [録音]タブに切り替え、[ステレオミキサー > 既定のデバイスとして設定]の順にクリック

- 再びタスクバーからスピーカーアイコンを右クリックし、[音量ミキサーを開く]をクリック

- [システム]と[アプリ]の項目で出力デバイスと入力デバイスを指定

macOSの場合は、BlackHoleやSoundflowerなど、ステレオミキサーの機能が付いた外部アプリケーションをダウンロードする必要があります。

| サービス利用料 | 無料 |

| 主な機能 |

|

| 公式サイト | https://workspace.google.com/intl/ja/products/docs/ |

COTOHA Voice Insight

COTOHA Voice Insightは、NTTドコモビジネス株式会社(旧NTTコミュニケーションズ株式会社)が提供するコールセンター向けの音声認識サービスです。コールセンターに寄せられる電話での問い合わせから音声を抽出し、通話内容をテキスト化できるのが特徴です。テキスト化された通話内容をもとに、オペレーターの画面上にFAQを表示させたり、コールリーズンごとに設定された重要事項をチェックできたりと、さまざまな形で活用できます。

また、顧客の発話から感情の推移を表示できる感情認識や、オペレーターの話し方を自動的に評価できる応対分析など、分析機能も豊富に用意されています。簡易的な操作だけで発音辞書を登録できるため、初心者の方にとっても使いやすいサービスだといえるでしょう。

| サービス利用料 | 要問い合わせ |

| 主な機能 |

|

| 公式サイト | https://www.ntt.com/business/services/application/ai/cotoha-vi.html |

MiiTel Phone

MiiTel Phoneは、株式会社RevCommが提供する営業向けの音声認識サービスです。営業電話やインサイドセールスでの通話内容をAIが解析し、その分析結果をもとに営業活動の改善提案を行ってくれます。

集計機能を利用すると、営業担当者ごとの稼働実績やセールストークの傾向といったデータを可視化できます。平均通話回数や通電率、応答率といったデータをヒットマップで表示できるのも特徴です。このようなデータをAIが自動で解析し、「どのタイミングで・どのような内容を・どういった話し方で訴求すれば良いか」といった具体的な改善策を提案してくれます。

また、CRM(顧客管理)ツールやSFA(営業支援システム)と連携することで、顧客情報の入力や日報作成といったノンコア業務の多くを自動化できるのもポイントです。

| サービス利用料 | 月額5,980円/ID |

| 主な機能 |

|

| 公式サイト | https://miitel.com/jp/service/phone/ |

AI音声認識システムの導入事例

全国に160ヶ所の拠点を構えている大和証券株式会社では、膨大な量の商談データをCRMツールに入力する必要があったものの、すべての従業員がタイピングに慣れているわけではなく、入力に時間がかかったり記録が最低限になったりといった問題を抱えていました。この課題解決のため、Google Cloudに搭載されている音声認識サービス「Speech-to-Text AI」を導入しました。

Speech-to-Text AIは、金融業界独自の専門用語にも対応できる高い認識精度を誇ります。そのため、同社ではテキストベースのデータ入力を、Speech-to-Text AIによって音声認識ベースへと切り替えることに成功しました。結果、タイピングの負担が減って商談内容を詳細に記録できるようになり、情報量が増えて業務効率が向上しています。

また、今後は、顧客情報をGoogle Maps Platformに移行してルート検索を活用することで、業務効率化を図るほか、AI技術をさらに活用して、PDFの自動翻訳や社内情報の横断検索などにも取り組む計画です。

音声認識技術を活用して業務効率化や顧客満足度の向上につなげよう

最近では、AI技術の進展に伴って音声認識の精度が向上し、関連するさまざまなサービスが登場しています。カスタマーサポートに特化したものや営業活動を支援するものなど、その種類はさまざまで、活用方法次第で業務効率化や顧客満足度の向上といった恩恵をもたらします。

音声認識は単に音声をデータに変換するだけでなく、テキストデータへと出力するため、生成AI技術を採用したサービスも数多く存在します。とはいえ、いままで生成AIサービスに触れたことが少なく、どのように活用すれば良いか不安を感じている方も多いのではないでしょうか。

電算システムでは、生成AIに関する導入・活用支援サービスを提供しています。ビジネスシーンで生成AI技術を導入する際のガイドラインの整備やクラウド移行計画の策定、そのほか、業務データ連携や従業員への技術トレーニングなど、さまざまなサポートが可能です。

すでに3,000社以上の導入実績があり、官公庁からIT企業まで幅広い企業でご活用いただいております。もし、「生成AIサービスを活用したいが具体的なイメージが湧かない」といったお悩みを抱える方は、ぜひ電算システムへと気軽にお問い合わせください。

- カテゴリ:

- Google Cloud(GCP)

- キーワード:

- 音声認識